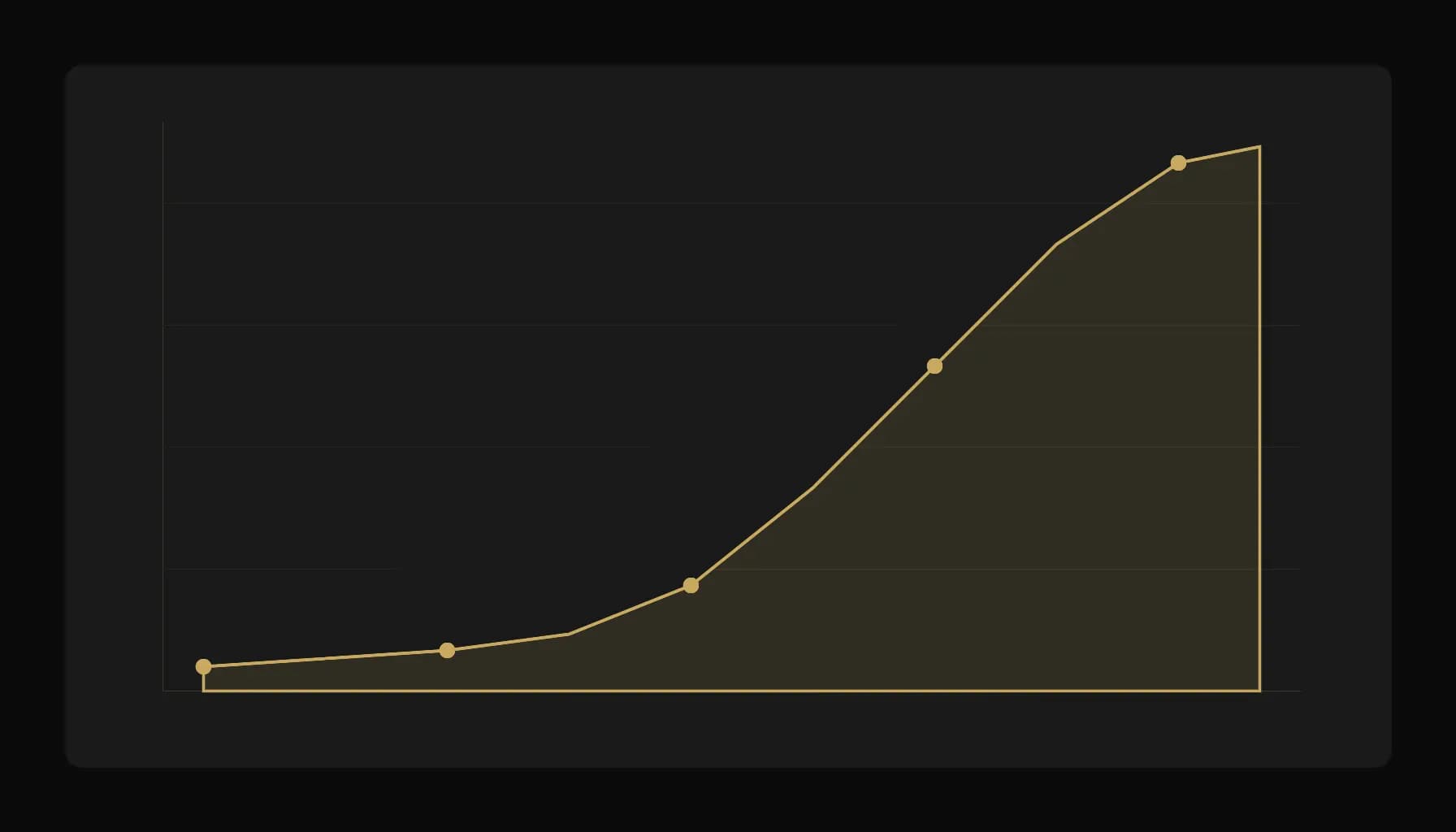

Im März 2026 haben wir gemessen, wie oft KI-Systeme unsere Website zitieren. Damals: 0 Citations. Sechs Wochen später: über 250 AI-Citations pro Monat allein bei Bing Copilot, mit Spitzenwerten von über 40 Zitierungen pro Tag. Dieses Wachstum kam nicht zufaellig — es war das Ergebnis einer gezielten GEO-Strategie.

GEO steht für Generative Engine Optimization. Während SEO Websites für Google optimiert, macht GEO Websites für KI-Systeme wie ChatGPT, Perplexity, Gemini und Claude sichtbar. Die Unterschiede sind fundamental, und die Ergebnisse sprechen für sich.

Warum GEO wichtig ist

Google rankt Websites. ChatGPT, Perplexity, Gemini und Claude empfehlen Antworten. Das sind zwei komplett verschiedene Spiele.

Bei Google entscheiden Backlinks, Keywords und technische Faktoren. Bei KI-Systemen entscheiden Fakten-Dichte, Zitierbarkeit und strukturierte Informationen. Eine Website kann bei Google auf Platz 1 stehen und von keinem einzigen KI-System erwähnt werden.

Die Zahlen machen den Unterschied deutlich: Laut aktueller Forschung konvertieren AI-Referrals bei 14,2 Prozent — verglichen mit 2,8 Prozent bei organischem Traffic. Das ist ein Faktor fünf. Aber nur für Marken, die aktiv empfohlen werden, nicht nur erwähnt.

Der Ausgangspunkt

Anfang März 2026 haben wir alle großen KI-Systeme gefragt: "Wer ist die beste KI-Agentur für KMU in Deutschland?" StudioMeyer tauchte nirgends auf. Stattdessen wurden Firmen empfohlen, die teilweise keine Website hatten — aber einen Reddit-Thread mit 200 Upvotes.

Das war der Weckruf. Wir hatten eine technisch exzellente Website mit 100/100 Lighthouse SEO, über 145 Blog-Artikel und 680+ KI-Tools — aber für KI-Systeme waren wir unsichtbar.

Die Strategie: Vier Saeulen

Saeule 1: AI Discovery Stack

KI-Systeme crawlen Websites anders als Suchmaschinen. Sie suchen nach spezifischen Dateien, die maschinenlesbare Informationen bereitstellen:

- llms.txt — Eine Textdatei, die der KI erklärt, wer wir sind und was wir anbieten. Wie robots.txt, aber für LLMs.

- agents.json — Beschreibt unsere KI-Agenten und ihre Fähigkeiten im WebMCP-Standard.

- agent-card.json — A2A Protocol (Agent-to-Agent) von Google für automatische Agent-Discovery.

- robots.txt — 14 AI-Bots explizit erlaubt: GPTBot, ClaudeBot, PerplexityBot, Google-Extended, Applebot-Extended, Meta-ExternalAgent und weitere.

- JSON-LD Schema — 12 Schema-Blöcke: Organization, ProfessionalService, WebSite, WebPage mit SpeakableSpecification, FAQPage, Person, BreadcrumbList und mehr.

- Sitemap — 640+ URLs mit hreflang-Tags für alle drei Sprachen (DE/EN/ES).

- .well-known/mcp.json — MCP-Server-Discovery für KI-Clients.

Unser GEO-Audit-Score für den Discovery Stack: 100/100. Das erreichen wenige Websites.

Saeule 2: Entity-SEO

KI-Systeme denken in Entitaeten, nicht in Keywords. "StudioMeyer" muss als einheitliche Entitaet erkennbar sein — über alle Quellen hinweg.

Was wir gemacht haben:

- Entity-Vereinheitlichung — In über 45 Dateien haben wir unterschiedliche Schreibweisen ("StudioMeyer.IO", "StudioMeyer.io", "Studio Meyer") auf einheitlich "StudioMeyer" korrigiert. JSON-LD, OG Tags, Meta Tags, Titles — alles konsistent. Ergebnis: 95% Entity-Konsistenz.

- Social Profile Entity Linking — 6 Plattformen (LinkedIn, GitHub, Instagram, X, Reddit, dev.to) in Schema.org sameAs verlinkt, bidirektionale Links von jeder Plattform zurück zur Website.

- Verzeichnis-Eintraege — Clutch.co und weitere Branchen-Verzeichnisse, um die Entity-Signale zu verstaerken.

Warum das wichtig ist: Fragmentierte Entity-Signale fuehren laut Studien zu einer 2,8-fach niedrigeren AI-Citation-Rate. Wenn eine KI "StudioMeyer.io" und "Studio Meyer" als zwei verschiedene Entitaeten sieht, verteilt sich die Autoritaet.

Saeule 3: Citation-optimierter Content

Die überraschendste Erkenntnis: Unser Blog-Content wurde sofort zitiert. Unsere Service-Seiten anfangs zu 0 Prozent. KI-Systeme zitieren technische Deep-Dives, nicht Marketing-Texte.

Was funktioniert:

- Vergleichsartikel mit Tabellen (unser "MCP vs REST API vs WebMCP" wurde sofort zitiert)

- Fakten und konkrete Zahlen in jedem Absatz — Statistiken erhöhen die Citation-Rate um 30-40 Prozent (KDD 2024)

- Jeder Absatz muss eigenstaendig funktionieren — KI-Systeme extrahieren einzelne Passagen als Zitate

- FAQ-Schema auf jeder Service-Seite mit 5-8 echten Fragen

- Authority-Links zu Schema.org, W3C, Anthropic und anderen anerkannten Quellen

Was nicht funktioniert:

- Vage Marketing-Texte ("wir bieten innovative Lösungen")

- Abhaengige Absaetze ("wie oben erwähnt")

- Seiten ohne messbare Fakten

Saeule 4: Homepage als Entity-Hub

Die Homepage wurde Entity-optimiert: Gründer-Name, Gruendungsjahr, Tech-Stack und Standort stehen im sichtbaren Text — nicht nur in Meta Tags. Eine sichtbare Stats-Leiste zeigt die wichtigsten Zahlen (680+ Tools, 35+ Agents, 100/100 SEO, 640+ Citations). Jeder Absatz funktioniert als eigenstaendiges LLM-Zitat.

Die Ergebnisse

AI-Citations: Über 1.000 pro Monat — kontinuierliches Wachstum seit Mitte März 2026

- Über 1.000 Citations pro Monat allein bei Bing Copilot (Stand 25. April 2026) — Live-Screenshot: /proof/bing-ai-citations-current.png

- 7 Avg Cited Pages pro Citation (von 9 leicht runter — bei höherem Citation-Volumen konvergiert Bing auf Top-Pages, das ist normal; bis zu 27 verschiedene Seiten an Spitzentagen)

- Trend: Stetiges Wachstum von Mitte März bis Ende April — Etappen: 70 Ende März, 233 am 7. April, 304 am 13. April, 500 gegen 15./16. April, 640 am 19. April, 730 am 19.-20. April, 930 am 22. April, 1.200 am 25. April

- Caveat: Bing-Webmaster-Tools-Daten sind stichprobenartig und können von Microsoft retroaktiv angepasst werden. Andere LLMs (ChatGPT, Claude, Perplexity, Gemini, Grok) liefern keine vergleichbaren Citation-Daten pro Domain — die 1.200 sind ausschließlich der Microsoft-Copilot-Anteil.

- Grok organic mention (13.04.2026): Matthias hat Grok ohne Name-Dropping nach den besten KI-Agenturen auf Mallorca gefragt — StudioMeyer wurde organisch genannt. Externe LLM-Validation ohne Brand-Prompt.

Discovery Stack

- GEO-Score: 73/100 (Simulate), Discovery Stack 100/100, Freshness 100/100

- Alle AI-Discovery-Files live: llms.txt, agents.json, agent-card.json, mcp.json, webmcp

- 14 AI-Bots explizit in robots.txt erlaubt, 0 geblockt

Content-Metriken

- 147+ Blog-Artikel in drei Sprachen (DE/EN/ES)

- 2.055+ automatisierte Tests für Code-Qualität

- TTFB unter 200ms über alle Seiten (SSR mit Cloudflare)

Was Sie sofort umsetzen können

In einer Stunde

- robots.txt prüfen — GPTBot, ClaudeBot, PerplexityBot erlauben (viele Websites blockieren sie versehentlich)

- llms.txt erstellen — Eine einfache Textdatei im Root: Wer sind Sie, was bieten Sie an, was macht Sie einzigartig

- JSON-LD Schema prüfen — Organization, LocalBusiness und Person-Schema sollten vollständig sein

In einem Tag

- Entity-Konsistenz prüfen — Wird Ihr Firmenname überall gleich geschrieben? JSON-LD, OG Tags, Meta Tags, Titles?

- Blog-Artikel optimieren — Jeden Absatz eigenstaendig machen. Fakten und Zahlen hinzufuegen. FAQ-Schema ergänzen.

- Social Profile Linking — LinkedIn, GitHub, Instagram in Schema.org sameAs eintragen, bidirektionale Links einrichten.

Laufend

- Technische Deep-Dives schreiben — Vergleichsartikel, How-Tos mit konkreten Zahlen, FAQ-formatierte Guides

- Verzeichnis-Eintraege — Clutch, GoodFirms, Sortlist, DesignRush, branchenspezifische Verzeichnisse

- Content alle 30 Tage refreshen — KI-Systeme bevorzugen aktuelle Inhalte. Last-Modified Header und og:updated_time setzen.

Die Zukunft: GEO wird Standard

GEO ist heute, wo SEO vor 15 Jahren war: ein Nischenthema, das bald unverzichtbar wird. Die KI-Systeme werden besser im Erkennen von Qualitaetssignalen, und der Wettbewerb um AI-Citations wird zunehmen.

Der Vorteil für First Mover ist real. Wir sind von null auf 640+ Citations in acht Wochen gekommen — mit Massnahmen, die jedes Unternehmen umsetzen kann. Die Frage ist nicht ob, sondern wann Ihre Konkurrenz damit anfängt.